덤프버전이 더 최근에 편집되었을 수 있습니다. > 덤프판 보기

인공지능 칩

최근 편집일시 :

1. 개요[편집]

인공지능 칩(AI Chip)[1]은 기계학습 모델을 구축하여 인공지능 소프트웨어 구현을 하기 위해 특화 설계된 SoC이다.

2. 상세[편집]

2010년대 중반까지는 전용 API[2]를 활용한 GPGPU가 곧 인공신경망 구축을 위한 유일한 해답이라고 봐도 무방했다. 다만 어디까지나 GPGPU는 픽셀 단위 그래픽 작업에 특화를 위해 설계되었고, 이쪽 인공지능 분야에서는 단순 용도 변경한 것에 불과하기 때문에 여러 문제를 갖고 있었다. 우선 연산 성능은 강력한 반면, 양산이 가능한 제조사가 한 곳 뿐이기에 수요 대비 공급이 제한적이라 가격이 높았다. 또한 기존의 범용 GPU는 VRAM을 그래픽카드에 두고 CPU 데이터를 복제한 뒤 연산을 처리하고, 결과값을 다시 CPU에 복사하는 방식의 복잡하고 비효율적인 방식을 취하고 있어서 특정 기업의 특정 요구에 맞춰서 설계되지 못하는 동시에 자원 낭비가 심하여 높은 전력소비와 레이턴시가 고질적인 문제였다. 대규모 슈퍼컴퓨터나 데이터센터는 일반인 기준으로 상상하기 힘들 정도로 다량의 전력을 필요로 하고 냉각을 위해 막대한 금액을 사용한다. 또한 자율주행 자동차, 생성형 인공지능 등 1초라도 빠른 반응이 사용자에게 중요하게 작용하는 분야에 쓰이기에 낮은 전력소비와 레이턴시는 필수적인 요소로 불린다.

이 때문에 행렬곱셈, 비선형함수 계산 등의 AI 연산 외에 기타 업무는 최소한으로만 남겨서 이를 전용으로 수행할 칩의 필요성이 대두되었고 ASIC 방식 위주로 AI연산 워크로드에 맞춰 만들어진 단일 칩을 AI칩이라고 부르게 된다. 사용자들은 머신러닝 프레임워크를 통해 워크로드를 실행할 수 있고, 이에 따라 상용화된 일부 칩들은 소비전력 대비 AI 연산능력이 기존 칩들에 비해 매우 우월한 수준을 갖추는 경지에 이르게 되었다.[3] 따라서 2010년대 후반부터는, 슈퍼컴퓨터와 데이터센터는 물론이고 스마트폰, 태블릿 등 개별 전자 기기의 경우 기존 프로세서에 간단한 AI연산 용도로 NPU부분이 추가되는 추세이다.

3. 구조[편집]

- Layer-1(H/W) : CPU, GPGPU 등의 하드웨어를 제어하는 가상 명령어셋 지원.[4]

- Layer-2(S/W) : 머신러닝 연산처리를 지원하는 라이브러리, 프레임워크들.[5]

- Layer-3(Algorithm) : L-1.2를 통해 구축된 모델들.[6]

- Layer-4(Application) : L-3 기반의 부가 서비스.[7]

4. 분류[편집]

사용 목적에 따라 학습용과 추론용으로 나뉘며, 사용 환경에 따라 데이터센터와 엣지 컴퓨팅, 개별 노드 분야로 나누어 볼 수 있다.

4.1. 사용 목적[편집]

- 학습용은 딥러닝 학습을 통해 규칙을 찾아, 언어모델 등 파운데이션 모델 구축하는 용도이다. 현재 기술은 은닉층에 매개변수를 많이 넣을수록 유리한 구조[8]이기에, 아직까지는 병렬연산으로 가장 뛰어난 성능을 자랑하는 GPGPU가 가장 범용적으로 쓰인다. 다만 ASIC 방식으로 설계된 칩들이 장기적으로는 GPU를 대체할 만한 잠재성이 있다는 평가가 대다수이다.[9] 그러나 풍부한 소프트웨어 풀과 접근성으로 일명 “가져다 쓰는”게 가능해서 빠른 PoC가 가능한 GPGPU-CUDA 기반과 달리 소프트웨어 풀이 상대적으로 매우 빈약하다는 점이 지적되어, 자체 칩을 제작할 여력이 되는 일부 빅테크 기업들을 제외하곤 범용 GPU를 활용하는 방식이 여전히 대세이다.

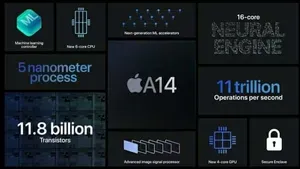

- 추론용은 학습을 통해 구축된 모델을 기반으로 예측 수행을 하는 용도이다. 가중치와 편향은 상술한 학습 과정에서 찾아두었으니, 예측값을 도출하는 것이다. 병렬만이 강점을 갖는 분야는 아니기에, 여기에서는 각각의 용도에 따라 GPU 외에도 CPU도 자주 쓰이며, 그 외에 FPGA, ASIC[10] 등도 쓰이는 경쟁시장 상태이다.

4.2. 사용 환경[편집]

- 데이터센터는 범용성이 뛰어난[11] GPU의 점유율이 압도적이다.

- 엣지 컴퓨팅은 데이터센터 과부화로 인한 부작용들을 막기 위한 중간 컴퓨팅이다. 개별 노드들의 데이터를 각지에 흩어져 있는 클라우드렛으로 우선 전송하고, 이후 데이터센터로 이동시킨다. 효율적인 통신을 위해 짧은 레이턴시가 매우 중요하며 GPU, ASIC, FPGA가 골고루 쓰이고 CPU는 잘 쓰이지 않는다.

- 스마트폰, 태블릿 등 개별 노드들에도 애플의 뉴럴 엔진을 시작으로 ASIC 기반의 NPU를 탑재하는 추세이다. 현재까지는 학습이 아니라 추론 용도로 개별 노드들에게 내재된 상태이다. 향후에는 개별 노드 단위로도 간단한 모델 구축이 가능한 온디바이스 형태로 발전시켜, 내재된 데이터를 통해 개별 기기 사용자들 맞춤형으로 발전될 예정이다.

5. 관련 기업[편집]

2023년 5월 기준으로 출시 예정 칩까지 포함하여 기업별 가장 강력한 칩셋을 대표로 서술했다.

2022년을 기준으로 엔비디아가 80% 내외의 점유율을 기록하며 1위 사업자 자리를 공고히 지키고 있다. 현재 제대로 외부 고객에게 양산되고 있는 칩은 엔비디아의 제품이 유일하고, 이로 인해서 수요 대비 공급 부족 현상이 심화되자 고객사들은 하나 둘 ASIC 방식으로 칩 자립화에 도전하고 있는 상황이다.

5.1. 해외[편집]

- tenstorrent

- groq

- sambanova

- mythic

5.2. 국내[편집]

6. 관련 문서[편집]

[1] 아직 시장 형성 초기이기 때문에 GPU 산업이 초기에 그랬던 것처럼, 이 분야도 AI가속기 외에 AI칩, NPU 등 여러 명칭으로 혼용된다. AI칩은 SoC를 의미하며, 인공신경망 연산을 위해 설계된 NPU를 포괄하는 개념이다. AI가속기는 AI칩을 포함한 아키텍처를 통칭하는 더 큰 단위이다. 즉 NPU(연산 유닛) ⊂ AI칩(통합 칩) ⊂ AI가속기(아키텍처)다.[2] 엔비디아의 CUDA를 비롯해서 OpenCL, ROCm 등.[3] 대표적인 예시로 구글의 TPUv4는 1W당 1.62TOPS라는 기술의 혁신 그 자체를 보여주고 있다. 또한 테슬라 FSD칩에 탑재된 NPU도 144W의 낮은 소비전력으로 72TOPS 수준의 연산 능력을 보여준다. 엔비디아 대비 연산 성능 자체는 밀리지만, 소비전력 대비 연산능력은 이미 추월한 것이다. 이들은 장기적으로 대량 양산하고 가격을 낮춰, 규모의 경제 효과로 완전한 칩 자립화를 꿈꾸고 있는 상황이다.[4] CUDA, OpenCL 등.[5] PyTorch, Tensorflow, Tinygrad, Transformers 등.[6] 주로 트랜스포머 방식 사용.[7] ChatGPT, CodeWhisperer, GitHub Copilot 등.[8] 다만, 많이 넣는 것 외에 전처리 과정에서 유리하도록 질이 높은 데이터를 수집하거나 압축성이 좋은 모델을 만드는 것도 강력한 딥러닝 구축에 있어서 중요한 요소이다.[9] 대표적으로 구글의 TPU, 테슬라의 D1 등 GPU 주요 고객사들이 자체 ASIC 설계에 집중하머 장기적으로 대량 양산하여 GPU를 대체할 계획을 짜고 있다.[10] 애플의 뉴럴엔진, 테슬라의 FSD칩 등이 대표적 사례.[11] GPU 서버의 경우 AI추론이 아니어도 그래픽,영상 가속이나 대규모 연산 등에 사용이 가능하며 이외에 암호화폐 채굴 등에도 쓸 수 있어 일부 암호화폐 채굴 업체는 채굴 붐이 다 지자 가지고 있던 GPU자원을 활용해 AI학습 워크로드를 돌리는 사업으로 전환하기도 했다.[12] H100 Tensor Core GPU[13] 2022년 10월, TSMC 4nm 공정으로 출시. 2023년 기준으로 전세계에서 가장 강력한 퍼포먼스의 범용 가속기이다. 대표적으로 테슬라 오토파일럿이나 ChatGPT의 기반모델인 GPT-4 학습에 사용되었다.[14] TPU v4[15] TSMC 7nm 공정으로 출시. 알파고에 사용되어 유명해졌으며, 바드 구축을 위한 모델인 LaMDA와 PaLM 학습에 사용되었다. HBM 방식의 메모리를 탑재해서 최상의 대역폭을 자랑한다.[16] 컨슈머용 Edge 제품군도 있으며 이는 Coral 사의 Edge TPU 로 발매된다. USB 연결형부터 PCIe 형 까지 다양하다.[17] Neural Engine[18] iPhone 등의 모바일과 자사 PC 제품에 탑재한다. 위 프로세서는 11TOPS의 성능을 내는 Apple A14 Bionic의 Neural Engine이다. 학습보다는 iPhone 12 시리즈, Apple M1 시리즈 등 개별 기기에 탑재되어 가벼운 신경망 추론에 쓰인다. CPU와 GPU의 메모리를 그냥 합쳐 버려서 전력 효율이 좋고 병목 현상이 적은 편이다.[19] D1[20] 7nm혹은 5nm 공정으로 생산될 예정이다. 자율주행 자동차 개발을 위한 자사 슈퍼컴퓨터 플랫폼인 Dojo가 3,000개의 D1칩으로 구성되어 모델 학습에 쓰일 예정이다.[21] MI300[22] 세계 최초의 데이터센터용 APU라는 마케팅을 앞세워 CES 2023에서 공개되었다. 엔비디아의 H100을 직접 언급하며 1.6배의 대역폭, 2.4배의 집적도가 가능하다고 홍보했다. 2023년 연내로 출시 예정이고, 현재 업계에서는 가속기가 없어서 못사는 상황이기에 성능만 발표에서 언급한대로 나와준다면 없어서 못파는 칩셋이 될 전망이다.[23] MTIA v1[24] 2023년 5월에 공개한 자사 최초 가속기이다. 2020년부터 개발했고, 자사 맞춤화 알고리즘과 생성형 인공지능 등의 학습과 추론 분야 전반에 걸쳐 사용할 예정이라고 한다. TSMC 7nm 공정으로 출시 예정이며, PyTorch로 소프트웨어를 통해 RISC-V 아키텍처를 사용하고, SRAM을 캐시처럼 활용하는 방식으로 설계했다.[25] Gaudi-2[26] IPU-7[27] 세쿼이아캐피탈이 27억 달러라는 막대한 돈을 투자한 기업이다.[28] WSE-2[29] ATHENA[30] TSMC 5nm 공정으로 2024년 출시 예정. 공급이 제한적인데다 가격이 비싼 엔비디아 칩셋을 일부 대체하여 자사 LLM 구축에 사용할 예정이다.[31] Inferentia[32] WARBOY[33] 14nm로 생산된 컴퓨터 비전 특화 칩셋이다.[34] ATOM[35] X220

이 문서의 내용 중 전체 또는 일부는 2023-12-29 13:58:20에 나무위키 인공지능 칩 문서에서 가져왔습니다.

이 문서의 내용 중 전체 또는 일부는 2023-12-29 13:58:20에 나무위키 인공지능 칩 문서에서 가져왔습니다.